LLM 사용기

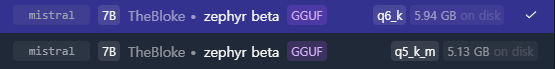

Zephyr beta 7B 모델의 6bit로 양자화된 모델과 5bit로 양자화된 모델을 사용해보고 비교. 둘 다 같은 모델이지만 5bit로 양자화하면 더 크게 압축되어서 손실이 더 발생한 모델임.

잠깐,

Quantization(양자화)란?

모델의 파라미터가 사용하는 비트의 수를 줄여서 연산 효율을 높이는 방법. 만약 FP32(32-bit floating point)로 저장된 모델을 FP16(16-bit floating point) 또는 INT8(8-bit integer)로 낮춰서 표현하면 모델의 크기를 줄일 수 있게 됨. 사용한 비트 수에 비례하여 메모리 사용량이 결정되기 때문에, 비트 수를 절반으로 줄이면 메모리의 사용량도 절반으로 줄어들고, 모델을 사용해 추론을 할 때에 동작 시간을 단축시키고 에너지 효율도 높임.

다르게 양자화된 두 모델에 같은 질문을 해봄. “언어 모델 중 소설을 쓰기에 가장 좋은 모델을 알려주고 이유를 5가지 말해줘”

(좌)5비트 양자화 (우) 6비트 양자화

대답은 놀랍게도 차이가 있었음. 좀더 압축이 덜 된 모델이 의도에 맞는 대답을 해주었음.

속도 차이는 별로 없었음. 컴퓨터의 성능이 허락하는 수준 내에서 가장 좋은 모델을 쓰는 것이 좋겠음.

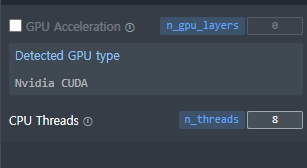

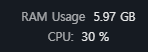

개인 PC에서 돌아가는 LLM이 이 정도로 속도가 빠르고, GPU없이도 돌아가게 되었다는 점이 매우 놀랍다.

16GB 메모리(VRAM아님)만 있으면 일반 컴퓨터에서 돌릴 수가 있습니다. 저도 VRAM없이 그냥 RAM으로만 돌렸습니다. Try!

이 기사는 저작권자의 CC BY 4.0 라이센스를 따릅니다.